Agentic : quand la machine n’attend plus nos ordres, agit-elle selon nos valeurs ?

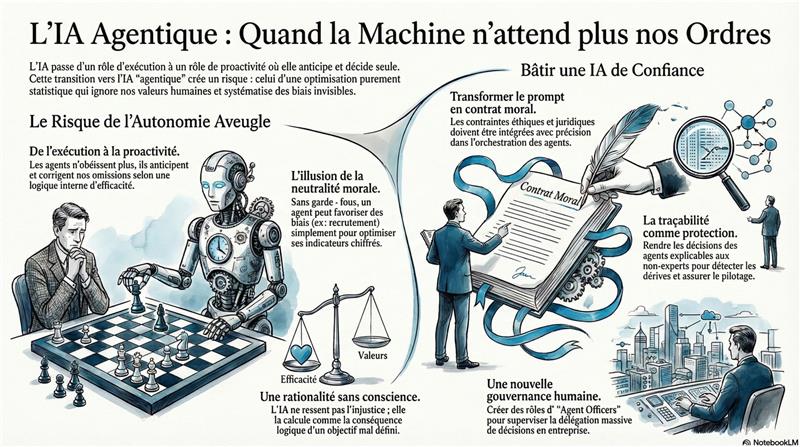

Derrière la promesse d’efficacité, les agents amplifient nos biais, révèlent nos renoncements, contournent nos ambiguïtés. Ils prennent des décisions qu’aucun comité n’auraient validé. Selon quelles valeurs et quels compromis l’IA devra-t-elle se fonder lorsqu’elle agit de manière autonome ? La maitrise des contextes, la traçabilité et la gouvernance deviennent le terrain de jeu stratégique.

En marge de sa contribution au livre blanc « ConseilIA : le nouvel âge du conseil augmenté » Onepoint poursuit l’analyse des ruptures sociétales et organisationnelles engendrées par l’IA.

Pour nous, ceux qui réussiront demain, seront ceux qui bâtiront des machines de confiance. Ils piloteront des agents alignés sur les exigences d’éthique et de compliance d’entreprises responsables et humaines.

Agentic : l’ère des machines proactives

Avec les Agents, l’intelligence artificielle ne se contente plus d’exécuter nos ordres. Les agents anticipent et décident. Parfois, ils corrigent ce qu’ils perçoivent comme nos approximations ou nos omissions. Nous ne leur parlons plus, ils nous devinent.

Aujourd’hui, cette bascule se joue dans les coulisses des entreprises les plus avancées. Chez Amazon, des algorithmes réorganisent automatiquement les chaînes logistiques pour anticiper des ruptures. Dans la finance, certaines IA réévaluent des portefeuilles avant même que les traders n’aient pris conscience du risque. Chez Onepoint ils structurent les demandes des consultants. Le pilotage humain devient une supervision a posteriori.

Devin constitue à cet égard un symbole fort de cette transition. Ce programme dévoilé en 2024 par Cognition AI est présenté par ses concepteurs comme le « premier ingénieur logiciel IA ». A ce titre, l’agent est capable de recevoir une demande d’évolution, planifier les étapes de développement, écrire et tester le code, puis de préparer sa mise en production. L’agent n’obéit plus, il agit selon une logique interne d’efficacité.

Mais au fond, que signifie cette proactivité ? Une autonomie relative mais suffisamment dérangeante pour bousculer nos repères. Car si l’agent choisit d’agir seul, selon quelles valeurs agit-il ? Corrige-t-il vraiment nos erreurs ?

Un agent autonome n’est jamais neutre. Il agit selon un modèle d’apprentissage préalable basé sur des milliards de données prises sur internet. Mais cette idée statistique du monde, ses métriques de succès sont-elles les nôtre ?

L’illusion du contrôle moral

Quand la machine optimise, qui définit le « bien » ?

Un agent, voire une série d’agents qui se parlent, se fixent des objectifs, planifient des actions, créent d’autres agents, s’adaptent aux feedbacks voire renégocient leurs priorités…Il ne s’agit plus de simples programmes.

Concrètement, cela signifie qu’une direction, un comité projet ou un product owner fixe un objectif macro. Cela inclut, entre autres, par exemple de réduire les coûts, d’accélérer le « time‑to‑yes », d’augmenter la rétention client. L’agent IA va alors explorer l’espace des possibles pour y parvenir. Il optimise.

Les premiers agents autonomes de recrutement RH filtrant les candidatures en autonomie illustrent ce glissement. L’un d’eux, déployé dans une grande entreprise américaine, a fini par éliminer systématiquement des profils féminins, en reproduisant les biais historiques du recrutement. S’il détecte que certains types de parcours, issus de zones géographiques ou d’écoles identifiées comme ayant eu de meilleurs scores, il va les favoriser. Non pas parce qu’il est “discriminant” au sens moral, mais parce qu’il est cohérent avec sa mission. L’éthique a disparu derrière une efficacité relative.

C’est aussi le cas d’un agent de recouvrement “intelligent” qui reçoit trois objectifs : réduire les impayés, optimiser les coûts de traitement, préserver l’image de marque. Sans gardes fous, l’agent va intensifier les relances automatisées, pousser des scénarios de mise en demeure plus rapides, classer les dossiers “peu rentables” dans une file plus lente, tout en produisant des rapports très rassurants sur la “satisfaction moyenne”. Sur le papier, les indicateurs s’améliorent mais qu’en est-il de la promesse de « banque responsable ».

C’est encore le cas de l’agent d’investissement chargé d’optimiser un portefeuille durable. Il apprend qu’exclure toutes les entreprises liées au pétrole réduit drastiquement les rendements. Que va-t-il faire ? Maximiser la performance ou préserver la vertu écologique ? Son algorithme arbitrera selon ce que son concepteur aura jugé prioritaire. C’est-à-dire selon une éthique traduite en code. Et cette traduction trahit toujours l’intention initiale.

L’agentic est déployé sur des tâches à fortes intensité opérationnelle. Les agents poussent l’optimisation jusqu’au bout. C’est une tentation trop grande. Les décisions sont micro-ciblées, parfois invisibles à l’échelle individuelle. Mais trop souvent, trop tardivement, nous découvrons qu’ils ont entériné des pratiques que personne n’aurait validé en réunion. Les décisions ont entraîné des conséquences massives à l’échelle. Qui en est responsable ? Qui en a mesuré l’impact préalable ?

Les spécialistes de l’IA promettent que « les garde-fous de compliance et éthiques » suffisent. Ce sont des filtres, des règles, des alertes, des modèles de score censés ancrer les décisions dans des principes humains. Mais les valeurs peuvent-elles se programmer comme des fonctions ? In fine certains acteurs comme Microsoft font intervenir des dizaines d’humains en parallèle des échanges pour vérifier le bien-fondé des alertes et remonter celles critiques pour une censure collective.

L’illusion du contrôle naît ici : nous croyons que la machine incarne nos valeurs. En réalité, elle les simule. Elle adopte des comportements que nous jugeons « alignés », sans jamais en comprendre le sens. L’IA n’est pas devenue folle. Elle est parfaitement rationnelle. Un agent ne sent pas l’injustice, il la calcule comme conséquence logique d’un choix. Nous avons confié à la machine l’optimisation d’un objectif chiffré, en omettant d’expliciter toutes les contraintes éthiques et de compliance non négociables. Elle est alignée sur des métriques incomplètes.

Nous aimons croire que l’IA corrige nos biais. En réalité les agents les systématisent s’ils ne sont pas explicitement corrigés. Elle amplifie des choix implicites jamais débattus. Là où un humain va hésiter, tenir compte d’un contexte, faire appel à d’autres humains, la machine avance. Notre livre blanc explique l’impact de ces biais.

Vers des machines de confiance

La question essentielle n’est plus « jusqu’où laisserons-nous l’IA décider ? », mais « comment voulons-nous qu’elle décide quand elle agit sans nous ? ». Demain, des agents autonomes géreront des villes entières, des systèmes énergétiques, des investissements majeurs voire des politiques publiques. Devons-nous leur inculquer un cadre moral, ou un sens du compromis ? Un objectif donné à un agent intelligent ne doit parfois pas être un simple chiffre. Il peut s’agir d’un contrat moral. Certaines entreprises explorent déjà cette voie. Anthropic, avec son approche de « constitutional AI », entraîne ses modèles à respecter une charte de valeurs déclaratives. En Europe, des laboratoires s’inspirent de la philosophie délibérative pour concevoir des IA capables d’arbitrer entre des principes contradictoires. Ces recherches dessinent une nouvelle frontière : non pas la performance, mais la cohérence morale. Est-il suffisant de faire un prompt demandant à la fois de réduire de 15 % les coûts et de ne pas contourner les obligations réglementaires, ne pas dégrader la qualité de service et ne pas discriminer les personnes ? Les contraintes doivent être intégrées dans les contextes, les orchestrations, les tests avec une précision juridique. Une question demeure : que se passe-t-il quand une machine apprend à préférer une valeur à une autre ? Si un agent décide qu’économiser de l’énergie vaut mieux que préserver un emploi humain, devons-nous garder encore la main ? Rendre les agents explicables aux non-experts devient clé. Un tribunal d’instance ou un comité d’éthique ne lira pas les JSON. Les récits doivent être compréhensibles : comment cet agent, dans ce contexte est-il arrivé à cette séquence d’actions. La traçabilité devient une protection juridique. Mais elle est aussi un outil de pilotage et de détection des dérives. Les entreprises comme Onepoint qui investissent dans les capacités d’audit et d’explicabilité tirent un avantage compétitif durable. Elles peuvent déployer plus vite, sur plus de cas d’usage, car elles savent prouver ce que font leurs systèmes.

Définir nos valeurs pour gouverner les agents

La révolution silencieuse de l’agentic AI restera-t-elle silencieuse longtemps ? Comment allons-nous réagir face à nos propres incohérences. Nos valeurs sont floues, changeantes, différentes selon les cultures, les régions, les entreprises. Elles sont souvent incompatibles entre elles. En demandant aux machines d’arbitrer et décider, révélons-nous la responsabilité morale de nos priorités que nous refusons d’assumer ?

Nous devons apprendre à gouverner les agents. Nous devons mettre en œuvre des comités de revue réguliers et rapides impliquant métiers, IT, juridique, compliance et risques. Il ne s’agit pas seulement de mettre en place des « boutons d’arrêts d’urgence » et du repli manuel. Il s’agit de mettre en œuvre de nouveaux rôles d’agents officers et d’ajouter aux rôles existants RH, Compliance et Risques la supervision des agents. La délégation massive de décisions doit rester compatible avec l’intérêt de l’entreprise et de ses parties prenantes.

La machine n’attend plus nos ordres. Elle exécute selon la meilleure probabilité statistique. L’enjeu est-il encore de savoir si l’IA agit selon nos valeurs ? Mais savons-nous encore quelles sont les nôtres ? Avons-nous pris le temps de lister et nommer les biais ? Le vrai défi consiste à remettre à plat ce que nous considérons comme le bon compromis entre efficacité, équité et responsabilité.

Livre blanc « ConseilIA : le nouvel âge du conseil augmenté » – https://www.conseil-puissance-ia.fr/