Trump, Open AI et Anthropic : début d’un drame orwellien pour nos démocraties ?

En 2026, l’administration Trump ajoute Anthropic sur sa liste noire pour avoir refusé de militariser Claude. OpenAI prend sa place au Pentagone. Mais il déclenche le mouvement #QuitGPT. Derrière ce conflit se profile surtout une question existentielle pour les démocraties. Jusqu’où peuvent-elles instrumentaliser l’IA sans trahir les valeurs qu’elles prétendent défendre ?

Le 27 février 2026, l’administration Trump décrète l’éviction d’Anthropique de l’ensemble de l’appareil fédéral1. Pete Hegseth enfonce ensuite le clou en estampillant la start-up de « risque pour la chaîne d’approvisionnement2 ». Cette mesure cible d’ordinaire les entités étrangères hostiles comme Huawei3, par exemple. Ce schisme fait suite à un différend éthique concernant l’exploitation du modèle Claude dans les opérations militaires.

Anthropic a, en effet, refusé de lever ses garde-fous, les « deux lignes rouges », sur la surveillance de masse et les systèmes d’armes autonomes4. Pendant ce temps, OpenAI a avancé ses pions sur l’échiquier. Sam Altman a annoncé la signature d’un contrat avec le Pentagone pour déployer ses modèles sur les réseaux militaires classifiés5.

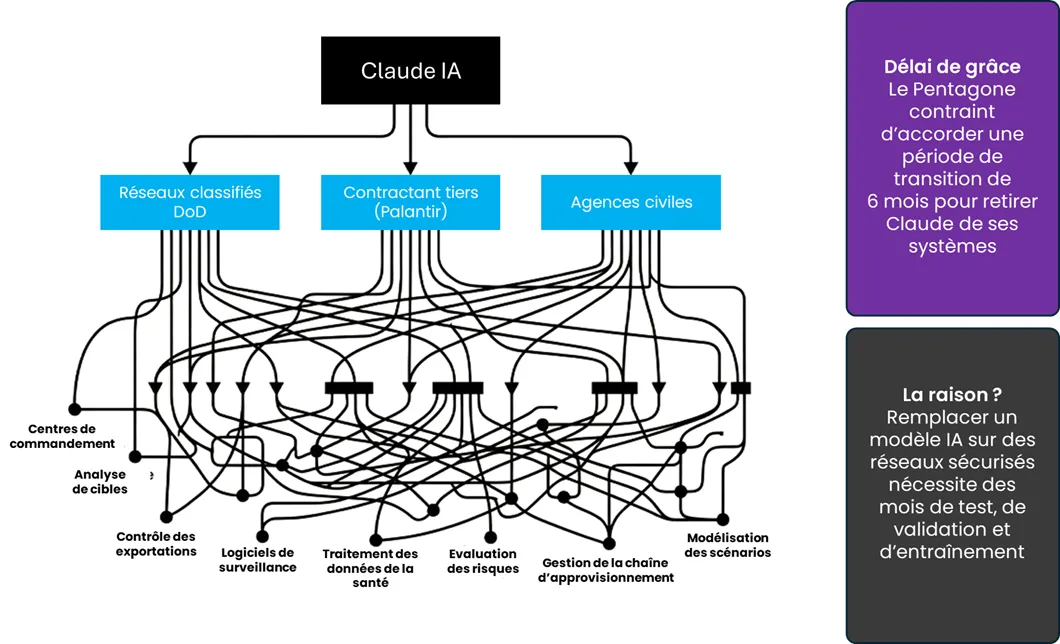

Moins de vingt-quatre heures plus tard, le Commandement Central américain (CENTCOM) déclenche des frappes massives contre l’Iran. Et ce, avec Claude en appui opérationnel direct6,7. Ce paradoxe s’explique. Le Pentagone ne peut pas encore arracher Claude de ses systèmes du jour au lendemain. Le commandement militaire des armées des États-Unis se voit donc contraint d’accorder une période de 6 mois de grâce à Anthropic8. L’IA s’est militarisée malgré elle, par l’inertie des systèmes déjà déployés, via les systèmes de Palantir9.

Etat de grâce ou pas, cette rupture dans les relations entre Anthropic et l’appareil d’État marque une première dans l’histoire américaine. Elle marque la fin de l’exceptionnalisme de la Silicon Valley. Avec le boycott des produits Anthropic, l’administration Trump a signifié aux géants de la Tech la fin de leur neutralité. D’antan, le modèle historique reposait sur un pacte tacite. L’État commandait, l’industrie fabriquait. Lockheed construit des F-3510, Boeing des bombes11. L’éthique, dans ce contrat-là, ne figure pas au cahier des charges.

Ce schéma vole en éclats avec ce bras de fer et le conflit engagé contre l’Iran. Le nouveau complexe militaro-industriel intègre désormais un acteur idéologiquement autonome : l’entreprise technologique, qui a ses propres valeurs, ses propres lignes rouges. Le code source y est devenu aussi sensible que l’enrichissement de l’uranium.

L’IA se militarise et surveille.

L’actualité brûlante, sans jeux de mot, sur l’automatisation par l’IA de la guerre et de la surveillance met en lumière la nécessité d’une régulation législative transparente12. Et ce, pour garantir que le futur ne parle pas avec la voix de ceux qui ont programmé son silence, mais demeure sous le contrôle des processus démocratiques.

Du fil à retordre avant de désinstaller complétement Claude AI de l’ensemble de l’appareil fédéral

L’absence d’intervention humaine : un danger pour la vie et l’éthique

La rupture entre le Pentagone et la start-up Anthropic tient au refus de cette dernière d’autoriser son modèle d’IA, Claude, à piloter des systèmes d’armes entièrement autonomes. Comprenez, par-là, des systèmes capables de désigner des cibles et d’engager des tirs sans qu’aucune décision humaine n’intervienne dans la boucle. Notez que la question du droit de tuer conférer à une machine n’est pas nouvelle. Le romancier Isaac Asimov l’avait reléguée au rang de la science-fiction dès 1942, en formulant ses « trois lois de la robotique13 ».

Revenons à la réalité où Le PDG d’Anthropic a en revanche tracé dans le sable deux lignes rouges à ne pas franchir avec l’IA.

« L’IA, trop immature pour décider de la vie et de la mort »

Pour Dario Amodei, PDG d’Anthropic, les grands modèles de langage actuels n’ont tout simplement pas atteint le niveau de fiabilité requis pour engager des décisions létales14.

Les systèmes d’IA de « frontière » s’avèrent imprévisibles. Leurs erreurs, bénignes dans un contexte civil, deviendraient catastrophiques sur un champ de bataille. Livrer un tel outil à des opérations militaires autonomes sans supervision humaine, c’est, aux yeux d’Anthropic, mettre délibérément en danger des vies. Par conséquent, l’entreprise californienne ne commercialisera pas sciemment un produit dont les défaillances connues pourraient tuer15.

Les « lignes rouges » d’Antropic : haro aux armes autonomes létales et à la surveillance de masse

Dario Amodei, PDG d’Anthropic, a structuré son refus autour de deux exceptions précises, les « lignes rouges ». A savoir, les armes autonomes surveillance de masse domestique régies par l’IA.

Interdiction de la surveillance de masseL’IA ne doit pas être exploitée pour la surveillance non ciblée des citoyens et résidents américains sur le sol national. Incompatible avec les valeurs démocratiques et le droit à la vie privée (4e amendement). |

Interdiction des armes autonomes létalesMachines capables de sélectionner et d’engager une cible létale sans intervention humaine (out of the loop). Refus de déléguer le droit de vie ou de mort. Imprévisibilité fondamentale des modèles actuels, incapables de garantir la distinction civil/combattant. |

Les « deux lignes rouges » d’Anthropic

Première ligne rouge : les armes autonomes léthales

Outre l’écueil de fiabilité soulevé par Dario Amodei, c’est un abîme éthique et juridique qui s’ouvre dès lors qu’on retire l’humain de la boucle de décision. Et le droit international de la guerre ne dispose pas encore des outils pour combler ce hiatus. Le Pentagone invoque la « Directive 3000.0916 », pour justifier ses usages, les efforts internationaux au sein de l’ONU pour limiter ou interdire les armes létales autonomes sont actuellement dans l’impasse. Elle se heurte néanmoins à l’opposition de grandes puissances comme les États-Unis et la Russie17.

Sans « supervision humaine significative », la capacité d’exercer un jugement critique face à des situations complexes s’érode dangereusement. Dans un contexte de guerre, cette dilution du contrôle humain pourrait conduire à des erreurs tragiques : ciblage accidentel de civils ou tirs fratricides.

« Supposons que je dispose d’une armée de 10 millions de drones, tous coordonnés par une seule personne ou un petit groupe de personnes. Vous comprenez bien qu’il y a là un problème de responsabilité, n’est-ce pas ? Vous comprenez bien que concentrer autant le pouvoir ne fonctionne pas. », Dario Amodei, fondateur d’Anthropic, interviewé par CBS le 1er mars 202618.

Deuxième ligne rouge : l’hypersurveillance prédictive

Anthropic a également tracé une deuxième ligne rouge. Celle-ci concerne la surveillance de masse domestique. Pour l’entreprise californienne, déployer l’IA à cette fin se révèlerait incompatible avec les valeurs démocratiques et le droit à la vie privée.

L’entreprise craint que l’IA assemble des données éparpillées et inoffensives pour construire une image complète et automatisée de la vie de n’importe quel citoyen. Cela inclut, entre autres, ses opinions politiques, ses relations, sa santé, ses habitudes. C’est ce qu’on appelle « l’effet mosaïque » (« mosaic effect19 »).

Faille législative : une porte ouverte à la gouvernance orwellienne

Le danger orwellien, outre ce Big Brother centralisé qui collecte tout, c’est bien l’IA qui fait parler des données auparavant muettes. La distinction traditionnelle entre données personnelles sensibles (opinions politiques, orientation sexuelle, santé…) et données non sensibles est dès lors battue en brèche20.

L’IA peut inférer avec une grande probabilité les opinions politiques à partir des goûts musicaux, des centres d’intérêt ou des comptes que suivis. Une étude a en effet déjà montré que des attributs intimes et sensibles sont prédits automatiquement à partir de données comportementales comme les « likes » Facebook21.

Rien n’échappe plus à la catégorie des données sensible une fois traitée par l’IA. La possibilité d’un passage de la surveillance à l’hypersurveillance prédictive apparaît donc préoccupante.

Une telle capacité d’hypersurveillance, entre les mains d’un État, ronge la démocratie de l’intérieur. Savoir que ses faits et gestes, ses échanges en ligne et ses affiliations peuvent être scrutés et reconstitués à tout moment pousse à l’autocensure. C’est ce que les juristes américains appellent les « chilling effects22 ». La liberté d’expression s’érode alors par la simple conscience d’être observé.

C’est l’antithèse d’une société ouverte. Et l’arme rêvée pour qui voudrait museler une opposition, mettre sous pression des journalistes, surveiller des militants ou façonner discrètement l’opinion publique.

Et à ce propos, le droit prédit mal ce qu’il n’a pas encore vu. Et c’est précisément dans cette faille, que Dario Amodei y perçoit le danger de l’hypersurveillance pour nos démocraties23.

Open Ai : une victoire à la Pyrrhus contre Anthropic en dépit de sa troisième « ligne rouge »

Le Pentagone exigeait un accès « total et sans restriction » aux modèles. Anthropic a opposé une fin de non-recevoir, jugeant incompatibles avec la vision « AI-first » de l’administration actuelle. Le Pentagone a donc officialisé le choix des modèles d’OpenAI.

La troisième ligne rouge d’Open Ai

OpenAI a choisi une approche plus flexible qu’Anthropic. Son PDG, Sam Altman, a accepté le principe de « tout usage légal ». Cette concession s’est toutefois accompagnée de trois garanties renégociées, formalisées par une troisième ligne rouge plus symbolique proposée au Pentagone. Cette dernière stipule l’interdiction de développer des systèmes comparables au « crédit social » chinois. Rappelons que c’est un mécanisme par lequel Pékin note et classe ses citoyens en fonction de leurs comportements pour leur accorder ou refuser l’accès à certains services24.

Stratégie de déploiement via le Cloud : un garde-fou au pied d’argile

Sur le plan technique, OpenAI a également fait un choix présenté comme un garde-fou. Cela implique que ses modèles seront accessibles via le cloud, c’est-à-dire depuis des serveurs distants25. Ils ne seront pas intégrés directement dans les équipements militaires de terrain tel que les drones, capteurs, systèmes d’armes.

Mais ce verrou est considéré comme fragile par les analystes. Le contrat impose en effet de se conformer au décret présidentiel EO 12333. Ce texte ancien autorise la collecte massive de données dès lors qu’un objectif de renseignement étranger est invoqué26.

Or des agences comme la National Security Agency (NSA) ont, par le passé, interprété cette notion de façon très extensive. Elles ont ainsi pu justifier la surveillance de communications transitant simplement par le territoire américain, sans lien direct avec une puissance étrangère27.

En s’engageant à respecter ces cadres légaux sans les remettre en cause, OpenAI prend le risque de devenir, malgré ses garanties affichées, le moteur d’une surveillance de masse généralisée28.

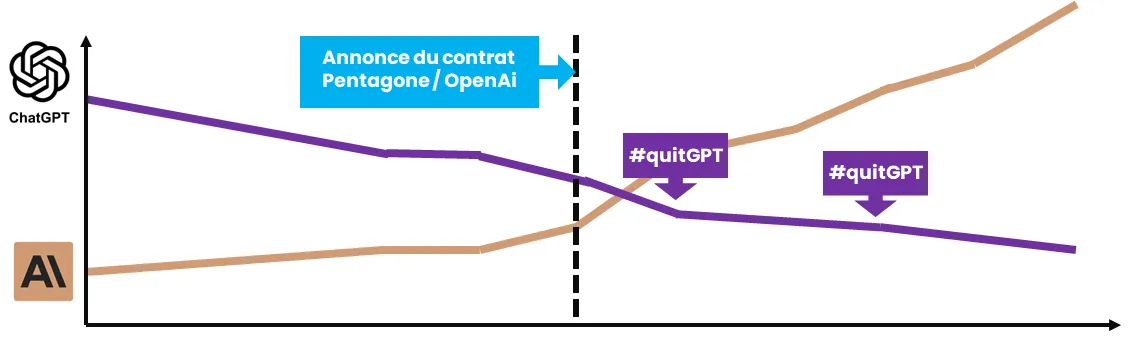

Le coût de l’opportunisme d’Open Ai : plus d’engagement du public pour Anthropic et une vague de « QuitGPT »

Le sentiment que Sam Altman a « trahi » les principes de sécurité de l’IA pour s’emparer de contrats militaires a provoqué un retour de flamme dévastateur29.

L’impact sur le marché grand public est tangible. Le mouvement #QuitGPT a entraîné une vague massive de résiliations30.

Paradoxalement, l’éviction d’Anthropic produit l’effet inverse de celui escompté. En faisant de Claude une figure de résistance aux yeux du grand public, elle lui offre une visibilité mondiale. Claude s’est hissé à la 1ère place de l’App Store américain31.

Les données confirment l’ampleur du phénomène. Depuis le début de la crise, Anthropic enregistre une hausse de 60 % de ses utilisateurs gratuits et un doublement de ses abonnés payants32.

Derrière ces chiffres se dessine un mouvement de fond. Une partie du public se tourne délibérément vers une entreprise qu’il perçoit comme ayant refusé de sacrifier ses principes éthiques sur l’autel des contrats militaires.

Le malaise est tout aussi profond chez les ingénieurs. Une lettre ouverte, signée par des centaines d’ingénieurs d’OpenAI et de Google, exige le maintien des garde-fous éthiques dans les contrats militaires33. Acculé, Sam Altman a tenté de rassurer ses équipes en affirmant que si un ordre lui semblait inconstitutionnel, il préférerait la prison à l’obéissance34.

Pour une régulation législative et une responsabilité des États

Cauchemar orwellien pour les uns, dystopie devenue réalité pour les autres… Le schisme entre un acteur de l’IA et le gouvernement américain ne manquera pas, à l’avenir, de faire couler l’encre des historiens.

En somme, la rupture avec Anthropic et le succès public immédiat de Claude auprès des citoyens suggèrent qu’un contrat social est en train de se rompre. Seule une régulation législative transparente pourra restaurer la confiance. Elle aura vocation à garantir que l’IA demeure un outil au service du droit et de la démocratie.

Le dépassement de l’arbitrage privé

Comme le soulignent Dario Amodei et Sam Altman, il n’est pas tenable à long terme que des entreprises définissent seules les limites de la sécurité nationale35. L’urgence est désormais à une intervention du Congrès pour moderniser un cadre juridique (notamment le 4ème amendement) totalement dépassé par les capacités de traitement de données de l’IA.

La redéfinition de la responsabilité étatique

La position du Pentagone exigeant un usage pour « toute fin légale » se heurte à une réalité technique où la loi n’a pas encore de prise sur les nouveaux risques de surveillance de masse automatisée et d’imprévisibilité des armes létales. La responsabilité des États doit donc évoluer vers la garantie d’une « supervision humaine significative », condition sine qua non pour préserver le jugement critique et la responsabilité morale sur le champ de bataille.

Le refus de la « course vers le bas »

L’argument de la nécessité stratégique face aux autocraties ne doit pas servir de prétexte à une érosion des valeurs démocratiques. Le risque est de voir les démocraties sacrifier leurs propres principes de liberté pour remporter une course technologique, adoptant ainsi les méthodes mêmes qu’elles reprochent à leurs adversaires.

Vers une nouvelle convention de Genève ?

Après les ravages de la Première Guerre mondiale, l’industrialisation de la guerre révéla brutalement que les progrès technologiques pouvaient dépasser les cadres juridiques existants. Cette réalité menaçait dès lors les principes fondamentaux du droit humanitaire. Les États furent contraints d’établir collectivement de nouvelles règles pour préserver un minimum d’humanité dans les conflits armés.

Aujourd’hui, l’intelligence artificielle pose un défi comparable en automatisant certaines fonctions militaires. Les conventions humanitaires visaient à maintenir l’homme au cœur du jugement moral et juridique sur le champ de bataille. L’essor des systèmes autonomes pourrait, au contraire, déplacer ce pouvoir vers des architectures techniques opaques et difficilement imputables.

Y aura-t-il un jour une régulation mondiale pour fixer de nouvelles « lignes rouges » plus claires et codifiée par la législation ? Des discussions sont déjà en cours pour adopter un instrument juridiquement contraignant visant à réguler ou interdire ces technologies d’ici 2026.

En mai 2025, des discussions informelles se sont, en effet, déroulés au siège de l’ONU. M. Guterres avait appelé les États membres à conclure un accord pour réglementer et interdire leur utilisation d’ici 202636. Parallèlement, des coalitions comme Stop Killer Robots font pression pour que les États rendent des comptes sur le développement de ces technologies37.

On saura dans les mois et les trimestres qui viennent si toutes ces discussions aboutiront. Et si d’autres, à la rescousse de ces dernières, œuvreront à la création de nouvelles « lignes rouges » claires et codifiées.

Nous sommes obligés de l’espérer…

Références

-

- Donald Trump, « Therefore, I am directing EVERY Federal Agency in the United States Government to IMMEDIATELY CEASE all use of Anthropic’s technology. », « @realDonaldTrump », Feb 27, 2026. ↩︎

- « Statement on the comments from Secretary of War Pete Hegseth », anthropic.com, Feb 27, 2026. ↩︎

- David Mortlock, Britt Mosman, David Levine, « Anthropic Designated a “Supply Chain Risk”: What Contractors Must Know ». ↩︎

- Matt O’Brien, Konstantin Toropin, « Trump orders federal agencies to stop using Anthropic technology in dispute over AI safety », defensenews.com, The Associated Press, Feb 28, 2026. ↩︎

- « OpenAI Defends Pentagon Deal, Claims Safety Exceeds Anthropic’s », bloomberglaw.com, Feb 28, 2026. ↩︎

- Auriane Polge, « Interdit par Trump, Claude a pourtant guidé des opérations militaires en Iran », science-et-vie.com, 03 Mar 2026. ↩︎

- Lee Jae-eun, « U.S. Military Uses Anthropic AI in Iran Airstrikes Despite Trump Ban », chosun.com, 02 Mar 2026. ↩︎

- Shannon Bond, Geoff Brumfiel, « OpenAI announces Pentagon deal after Trump bans Anthropic », npr.org, Feb 28, 2026. ↩︎

- La technologie d’Anthropic est profondément intégrée aux systèmes militaires américains, notamment via la société d’analyse de données Palantir. Lee Jae-eun, « U.S. Military Uses Anthropic AI in Iran Airstrikes Despite Trump Ban », chosun.com, 02 Mar 2026. ↩︎

- « The F-35’s Unrivaled Capabilities », lockheedmartin.com, 2025. ↩︎

- « Fighters and Bombers », boeing.com, 2026. ↩︎

- Pour Dario Amodei, la technologie a dépassé les lois actuelles (comme le 4e amendement) et la régulation de l’IA militaire et de la surveillance doit nécessiter une intervention du Congrès. « Full interview: Anthropic CEO responds to Trump order, Pentagon clash », youtube.com, CBS News, durée 27’43, 01 Mar 2026. ↩︎

- Isaac Asimov, « Runaround », Astounding Science Fiction, page 94, 132 pages, 1942.↩︎

- « Statement from Dario Amodei on our discussions with the Department of War », anthropic.com, 26 févr, 2026. ↩︎

- « OpenAI announces Pentagon deal after Trump bans Anthropic », npr.org, February 28, 2026. ↩︎

- Brendan Steinhauser, « Congressional Oversight Letter DOD AI », commoncause.org, 4 pages, February 26, 2026. ↩︎

- John K. Waters, Carol Evans, Sean Themea, « Pentagon Bans Anthropic After AI Maker Refuses to Drop Limits on Autonomous Weapons and Mass Surveillance », pureai.com, 03/02/2026.↩︎

- “Suppose I have an army of 10 million drones, all coordinated by one person or a small set of people. Can’t you see? I think it’s easy to see that there are accountability issues there, right? That, you know, concentrating power that much doesn’t work”, « Full interview: Anthropic CEO responds to Trump order, Pentagon clash », youtube.com, CBS News, durée 27’43, 01 Mar 2026.↩︎

- Adam Mazmanian, « The mosaic effect and big data », nextgov.com, May 13, 2014.↩︎

- L’Organisation de coopération et de développement économiques (OCDE) note que l’IA est de plus en plus capable de croiser différentes données pour réidentifier des individus ou déduire des informations sensibles. « L’intelligence artificielle dans la société », oecd.org, rapport de l’OCDE, 30 octobre 2019.↩︎

- Michal Kosinski, David Stillwell, Thore Graepel, « Private traits and attributes are predictable from digital records of human behavior », nih.gov, 2013 Mar 11.↩︎

- Ronit Matar , Daragh Murray, « Re-thinking international human rights law’s approach to identity in light of surveillance and AI », academic.oup.com, Human Rights Law Review, Volume 25, Issue 3, September 2025.↩︎

- « There’s this way in which domestic mass surveillance is get is getting ahead of the law. The technology is advancing so fast that it’s out of step with the law. » (Dario Amodei, Anthropic) « Full interview: Anthropic CEO responds to Trump order, Pentagon clash », youtube.com, CBS News, durée 27’43, 01 Mar 2026.↩︎

- Julien Damon, « Que penser du système chinois de crédit social ? », lesechos.fr, 12 juil. 2019.↩︎

- L’un des principaux garde-fous techniques d’OpenAI est la restriction de l’accès à ses modèles via une interface de programmation (API) sur le cloud. Katrina Mulligan, responsable des partenariats de sécurité nationale chez OpenAI, explique que cette limite garantit que les modèles ne peuvent pas être intégrés directement dans les systèmes d’armes, les capteurs ou tout autre matériel opérationnel sur le terrain. Ravie Lakshmanan, « Pentagon Designates Anthropic Supply Chain Risk Over AI Military Dispute », thehackernews.com, Feb 28, 2026.↩︎

- L’expert Mike Masnick souligne que ce décret est l’une des plus grandes failles permettant à la communauté du renseignement de surveiller les communications des Américains. Il permet la collecte massive dès qu’un objectif de renseignement étranger est invoqué. Ibid.↩︎

- « OpenAi is changing its contract with Pentagon-CEO Sam Altmansays “I would rather go to jail than… », indiatimes.com, Mar 03, 2026↩︎

- Les termes utilisés dans le contrat (comme l’interdiction de surveillance « non ciblée » ou « généralisée ») sont flous et laissent une grande marge d’interprétation au gouvernement. Ibid.↩︎

- Sanya Mansoor, « Anthropic’s AI model Claude gets popularity boost after US military feud », theguardian.com, Mon 2 Mar 2026.↩︎

- John K. Waters, « Pentagon Bans Anthropic After AI Maker Refuses to Drop Limits on Autonomous Weapons and Mass Surveillance », pureai.com, 03/02/2026.↩︎

- Ibid.↩︎

- Lee Jae-eun, « U.S. Military Uses Anthropic AI in Iran Airstrikes Despite Trump Ban », chosun.com, 2026.03.02.↩︎

- John K. Waters, « Pentagon Bans Anthropic After AI Maker Refuses to Drop Limits on Autonomous Weapons and Mass Surveillance », pureai.com, Silicon Valley divides, employee pushback, 03/02/2026.↩︎

- « OpenAi is changing its contract with Pentagon-CEO Sam Altmansays “I would rather go to jail than… », indiatimes.com, Mar 03, 2026 ↩︎

- « US agencies dump Anthropic as Altman revises Defense Department agreement », cybernews.com, 3 March 2026.↩︎

- « À mesure que l’IA évolue, la pression monte pour réglementer les robots tueurs », ungeneva.org, 02 juin 2025.↩︎

- Ibid.↩︎